大数据告诉你 什么是人工智能时代的人工智能公共数据

当我们谈论人工智能时代,我们谈论的不仅仅是精妙的算法和强大的算力,更是在谈论海量的数据。人工智能,尤其是以深度学习为代表的现代AI,其智能的“燃料”与“基石”正是数据。而在这些数据中,一个至关重要但常被公众忽视的类别,便是人工智能公共数据。它正以深刻的方式,定义着我们这个时代的AI面貌与未来走向。

一、什么是人工智能公共数据?

人工智能公共数据,简而言之,是指那些为了促进人工智能技术的研究、开发和应用,由政府、科研机构、非营利组织或企业主动公开、共享的,具有特定用途和格式的、高质量的数据集。

它与我们日常接触的“大数据”既有联系又有区别:

- 联系:它们都体量巨大,来源广泛。

- 区别:人工智能公共数据通常经过精心清洗、标注和组织,具有明确的格式标准和任务导向(如图像识别、自然语言理解、语音合成等),其核心价值在于可用性、可信性和公平性,而非单纯的规模。

典型例子包括:

1. 图像数据集:如ImageNet(1400多万张标注图片,推动计算机视觉革命)、COCO(用于目标检测和分割)。

2. 文本数据集:如维基百科语料(大语言模型的重要训练素材)、GLUE/SuperGLUE(用于评估模型自然语言理解能力的基准数据集)。

3. 语音数据集:如LibriSpeech(大量有声读物音频及文本转录)。

4. 科学数据:如天文观测数据、基因序列数据库、蛋白质结构数据库(如AlphaFold使用的数据)。

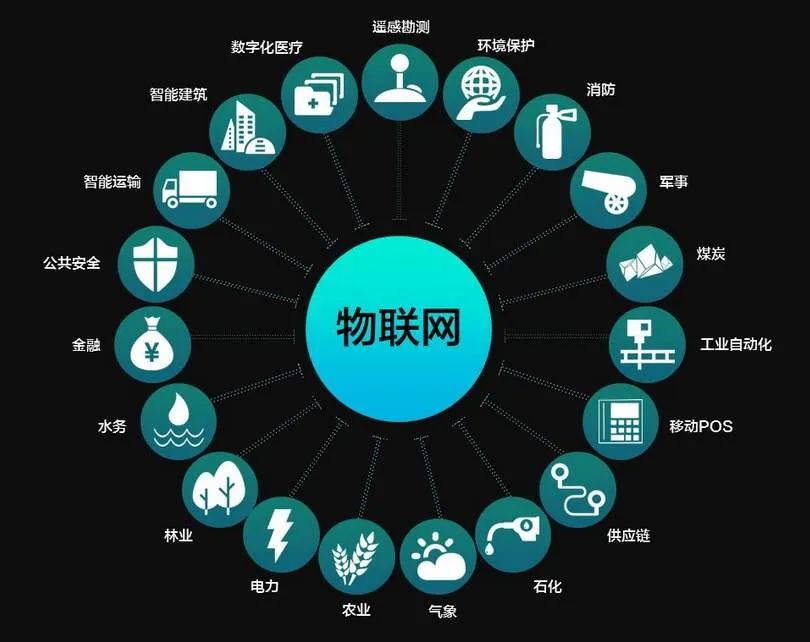

5. 政府开放数据:各国政府发布的交通、气象、经济、公共安全等领域的数据,经过处理后可用于城市大脑、智慧政务等AI应用。

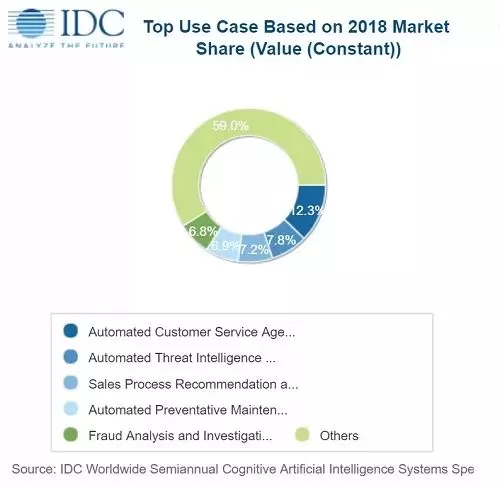

二、大数据视角下,人工智能公共数据为何是“时代基石”?

从大数据的分析中,我们可以清晰地看到人工智能公共数据的战略价值:

1. 降低创新门槛,推动普惠发展:

在AI领域,高质量数据一度是巨头公司的“私有护城河”。公共数据集的涌现,极大地降低了高校、初创公司和个人研究者的入门门槛。任何人都可以下载这些数据集,训练和验证自己的模型,这催生了全球范围内AI研究与创新的繁荣,避免了技术被少数实体垄断。

2. 提供基准与标尺,驱动技术进步:

像ImageNet、GLUE这样的公共数据集,不仅是训练集,更是全球AI研究社区的“统一考卷”。全球团队在这些标准数据集上比拼性能,创造了“ImageNet竞赛”等传奇,直接驱动了模型精度从量变到质变的飞跃(如AlexNet、ResNet的诞生)。它们提供了客观、可比较的进步标尺。

3. 促进算法公平与可解释性研究:

大数据分析揭示,AI模型可能放大现实社会中的偏见。针对这一问题,研究者们构建并开源了如FairFace(人脸分析公平性数据集)、BOLD(评估对话模型社会偏见的基准) 等公共数据集。这些数据旨在帮助检测和缓解算法偏见,推动开发更公平、透明、可信的AI系统。

4. 加速跨学科与产业融合:

公共数据是跨领域协作的“通用语言”。例如,生物医学领域的公共基因和蛋白质数据,与AI算法结合,催生了AlphaFold2这样的颠覆性成果。城市交通公共数据则让AI优化交通信号灯、预测拥堵成为可能。数据开放是“AI+”赋能千行百业的前提。

5. 奠定大模型时代的“预训练”基础:

当前如火如荼的大语言模型(如GPT系列)和基础模型,其“通识智能”很大程度上来源于对海量、多元互联网公开文本和代码数据的预训练。虽然具体训练数据常属商业机密,但其思想源头和早期发展严重依赖于维基百科、开源代码库(GitHub)、学术论文等公共或开放数据生态。

三、挑战与未来:从数据开放到数据生态

尽管价值巨大,人工智能公共数据的发展也面临挑战,大数据分析同样指明了方向:

- 质量与规模的平衡: 数据需要精准标注,但大规模人工标注成本极高。未来需要发展更高效的半自动、自监督数据构建方法。

- 隐私与安全的红线: 尤其是涉及人脸、医疗、个人行为等敏感数据,必须在脱敏、加密、合规的前提下开放。联邦学习等“数据不动模型动”的技术可能是解决方案。

- 动态更新与维护: 世界在变化,数据会过时。数据集需要持续维护和版本更新,这需要可持续的社区或机构支持。

- 标准与互操作性: 不同领域、不同格式的数据需要统一标准,才能更好地融合与利用。

未来趋势将是从简单的“数据公开”走向构建健康的 “数据生态” 。这包括:

1. 政府主导,建立国家级AI公共数据平台,将数据作为基础设施进行建设。

2. 激励与协作机制,鼓励企业、机构在保护核心利益的分享非敏感、高质量数据。

3. 发展数据信托、数据空间等新模式,在保障权益的前提下促进数据流通。

4. 重视“数据素养”教育,让更多人学会利用公共数据进行创新。

###

大数据清晰地告诉我们:人工智能公共数据,绝非冰冷的信息堆砌,而是点燃AI创新火花的燧石,是衡量技术进步的标尺,也是通往更公平、更普惠人工智能时代的桥梁。它定义了AI的“学习素材”,从而在很大程度上定义了AI的“智能”本身。建设好、利用好这一数字时代的核心公共产品,是我们拥抱和塑造人工智能时代的关键一步。